Як розпізнати дипфейки, створені штучним інтелектом: коментарі фахівців

Нещодавно оголені фотографії поп-зірки Тейлор Свіфт заполонили соціальні мережі, де їх переглядали та ділилися мільйони користувачів. Але зображення не були справжніми, це були дипфейки, створені за допомогою штучного інтелекту (ШІ). Інцидент розпалив дискусію про регулювання дипфейків і привернув таку увагу, що в справу втрутився Білий дім.

Але чи можливо захиститися від такого роду атак і чи легко розпізнати дипфейки?

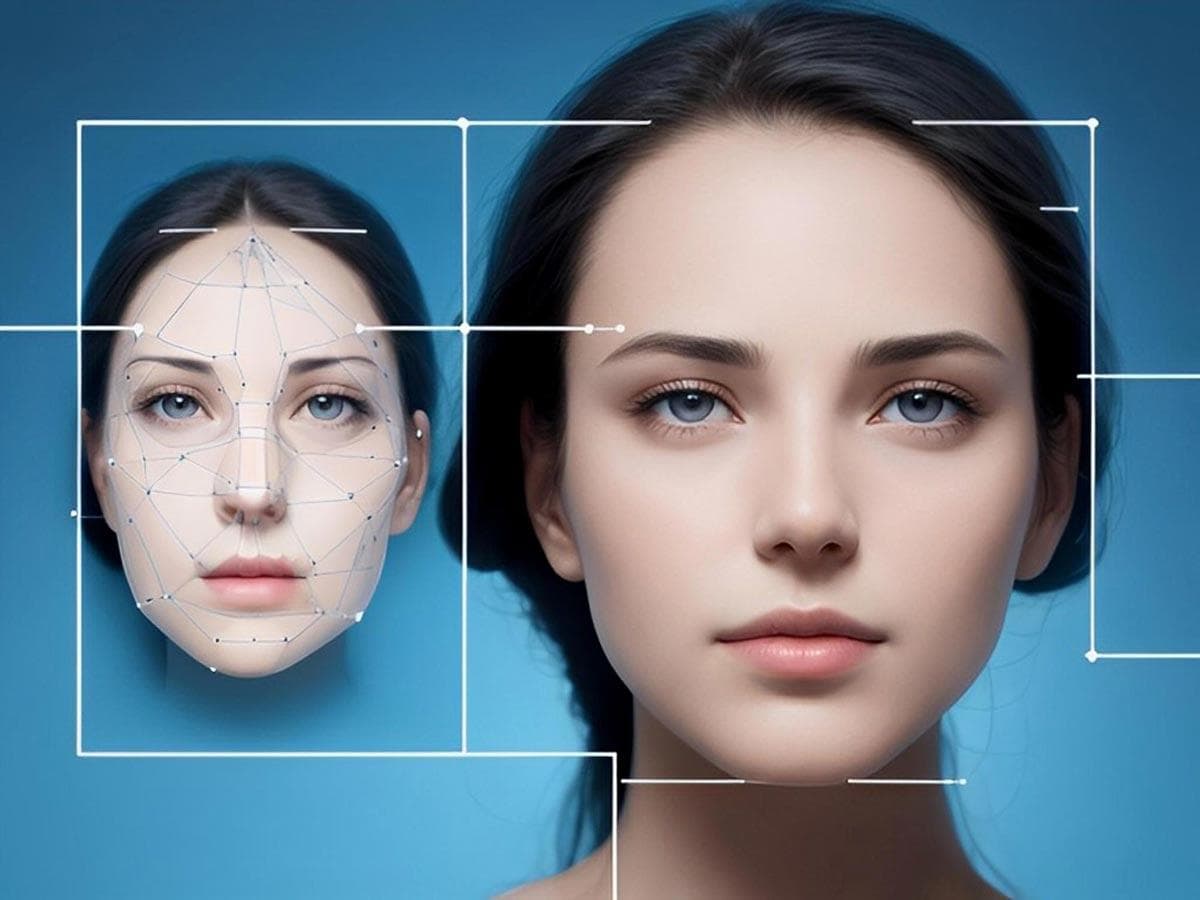

Що таке дипфейки?

Дипфейки – це створений комп’ютером текст, зображення, звуки, мова чи відео, які видаються за справжні, але такими не є. Людині може бути дуже важко визначити, чи є цей контент реальним чи він створений штучним інтелектом.

Розробка дипфейків почалася в 2014 році, коли було розроблено принцип навчання ШІ Generative Adversarial Network (GAN). Цей принцип дозволяє моделям штучного інтелекту тренуватися з іншими моделями штучного інтелекту, розробленими для виявлення дипфейків. В результаті такої “взаємодії” були розроблені нові моделі штучного інтелекту, які створюють ще якісніші дипфейки.

Мортен Мюруп, який займається дослідженнями штучного інтелекту в DTU Compute, називає це “гонкою озброєнь”:

«Ця гонка між двома моделями штучного інтелекту — коли одна намагається генерувати, а інша — виявляти підроблені матеріали — триватиме доти, доки модель виявлення більше не зможе розрізняти реальність і підробку.»

Технічні компанії та дослідники працюють над розробкою моделей штучного інтелекту, які можуть виявляти дипфейки, але навіть цим моделям буває важко зрозуміти різницю.

ТЕСТ: Спробуйте на цьому сайті потренувати свою інтуїцію та уважність. Яке з цих фото є справжнім?

Численні дипфейки змусили Meta, якій належать Facebook та Instagram, докласти зусиль для виявлення зображень і відео, створених комп’ютером. Закон ЄС про штучний інтелект — перше у світі законодавство щодо ШІ — зробить обов’язковим декларування комп’ютерного контенту. Однак, незважаючи на те, що в цій сфері розробляються нормативні акти, а технологічні компанії намагатимуться виявляти дипфейки, Мюруп вважає, що немає гарантії, що ми зможемо уникнути набагато більшої кількості дипфейків у майбутньому.

«Початок декларування дипфейків, безумовно, є важливим кроком, але все одно знайдуться люди, які зможуть генерувати контент без його декларування. Ведуться дослідження щодо розробки детекторів дипфейків на основі штучного інтелекту, але потім ми повертаємося до гонки озброєнь. І це гонка озброєнь, яку, на мою думку, буде дуже важко виграти», — каже Мюруп.

Наразі існує інший метод виявлення дипфейків, який повністю обходить штучний інтелект і базується на ретельних дослідженнях.

“Ви можете спробувати перевірити дипфейк за допомогою іншої інформації. Якщо відеоролик показує щось, що сталося, наприклад, в Україні, ви можете порівняти його із супутниковими знімками та інформацією про погоду на той час, щоб побачити, чи все відповідає відеоролику. Наприклад, того дня йшов дощ, а на відео видно безхмарне небо.

Єдина проблема полягає в тому, що моделі штучного інтелекту потенційно також можуть мати доступ до інформації, за допомогою якої ми перевіряємо відео. Тож якісний дипфейк буде мати на відео дощ», — каже Мюруп.

У 2019 році генеральному директору британської енергетичної компанії зателефонував той, хто, як він вважав, був своїм начальником у головній компанії в Німеччині, і сказав йому перерахувати 220 000 євро на банківський рахунок. Насправді генеральний директор був обманутий дипфейком. Шахрай використав штучний інтелект, щоб згенерувати голос начальника настільки переконливо, що директор негайно перерахував гроші. У лютому 2024 року велика компанія в Гонконзі пережила подібний інцидент і була ошукана на 25,6 млн доларів.

У Данії Міністерство закордонних справ уважніше стежить за дипломатичними відеорозмовами після того, як минулого року міністр закордонних справ Ларс Лекке Расмуссен отримав дипфейковий дзвінок від групи російських коміків, які підробили обличчя та голос голови комісії Африканського Союзу.

Хоча буває дуже важко запобігти подібним шахрайствам і поширенню дезінформації, створеної deepfake, Мюруп вважає, що краща обізнаність про проблеми є ключем до обмеження проблеми.

«Вимоги щодо декларування ускладнять звичайним користувачам створення дипфейків без виявлення, але й надалі будуть великі гравці, які будуть обманювати інших або впливати на демократичні процеси. Тому ми повинні визнати, що ці технології існують, і діяти відповідно.

«Нам потрібно практикувати критику джерел і розуміти, що ми живемо у світі дезінформації, де існують маніпуляції, які дуже важко виявити. Це буде великою проблемою якщо ми почнемо відкидати істину як дезінформацію та фальшивку, тому що вона не відповідає нашому світогляду», — каже Мюруп.

Підпишись на нас в Google НОВИНИ, та отримуй більше свіжих новин!